AI Act: quedan menos de 100 días — qué deben hacer las empresas españolas

Jorge García

Tecnea

El 2 de agosto de 2026 quedan menos de cien días. Esa fecha marca la aplicación plena de las obligaciones del AI Act europeo para la mayoría de sistemas de inteligencia artificial desplegados en empresas. No es una fecha simbólica: ese día la Agencia Española de Supervisión de la Inteligencia Artificial (AESIA) tendrá poderes plenos de inspección y sanción, y la Comisión Europea activará su capacidad de multar a los proveedores de los grandes modelos de IA.

La pregunta que deberían hacerse ahora mismo los responsables de tecnología y operaciones de cualquier empresa mediana española no es si el AI Act les afecta. La pregunta es: ¿cuántos sistemas de IA de alto riesgo tienen desplegados sin saberlo?

La respuesta, en muchos casos, va a sorprender.

La línea de tiempo completa: qué ya obliga y qué llega en agosto

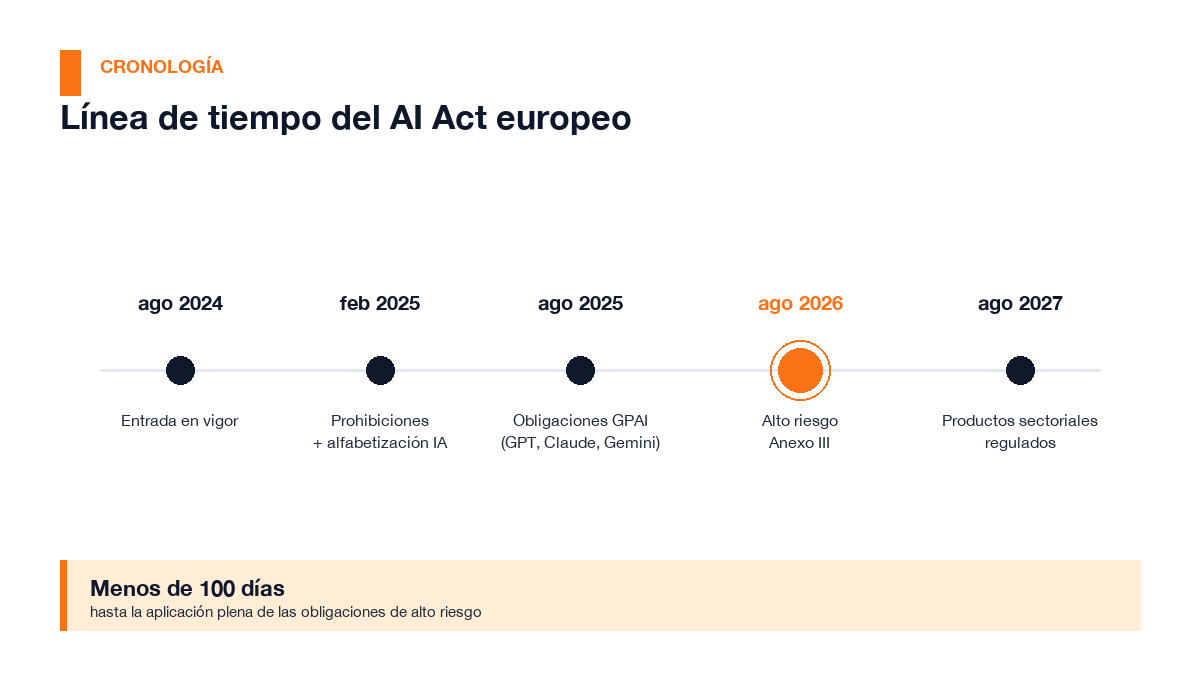

El AI Act ha entrado en vigor por capas desde agosto de 2024. La fecha crítica para la mayoría de empresas es el 2 de agosto de 2026.

El AI Act ha entrado en vigor por capas desde agosto de 2024. La fecha crítica para la mayoría de empresas es el 2 de agosto de 2026.

El AI Act no llegó de golpe. Lleva dos años entrando en vigor por capas, y la mayoría de las obligaciones críticas se concentran precisamente ahora:

- Agosto 2024 — El Reglamento entra en vigor oficialmente.

- Febrero 2025 — Prohibiciones absolutas (Art. 5): manipulación subliminal, explotación de vulnerabilidades, scoring social masivo. Obligación de alfabetización en IA (Art. 4) para todo el personal que trabaje con sistemas de IA.

- Agosto 2025 — Obligaciones para modelos de IA de propósito general (GPAI): GPT, Claude, Gemini, Llama. Normas de gobernanza y documentación técnica.

- 2 agosto 2026 — Obligaciones plenas para sistemas de alto riesgo (Anexo III). Poderes de sanción de la Comisión sobre GPAI. Reglas de transparencia.

- Agosto 2027 — Sistemas de alto riesgo integrados en productos sectoriales ya regulados (maquinaria, dispositivos médicos…).

Hay un matiz que pocos artículos recogen: algunos sistemas autónomos del Anexo III tienen en realidad hasta diciembre de 2027. Pero eso no es una excusa para esperar: la clasificación de sistemas es obligatoria para todos desde ya, y los procesos de documentación técnica y gestión de riesgos llevan meses de trabajo.

¿Tienes sistemas de alto riesgo sin saberlo?

Las 8 categorías del Anexo III. Las más frecuentes en empresas medianas españolas son Empleo/RRHH y Servicios esenciales (crédito, seguros).

Las 8 categorías del Anexo III. Las más frecuentes en empresas medianas españolas son Empleo/RRHH y Servicios esenciales (crédito, seguros).

El Anexo III del AI Act define ocho categorías de sistemas considerados de alto riesgo. No hace falta tener tecnología de vanguardia para caer en alguna de ellas. Estas son las más frecuentes en empresas medianas españolas:

Empleo y recursos humanos

Es probablemente la categoría que más empresas ignoran. Son de alto riesgo los sistemas de IA que:

- Filtran o puntúan candidaturas de empleo de forma automatizada

- Evalúan a candidatos durante procesos de selección

- Toman o asisten decisiones de promoción, reasignación o despido

- Monitorizan y evalúan el rendimiento de empleados

Si tu empresa usa un ATS (sistema de seguimiento de candidatos) con puntuación automática, o una herramienta de People Analytics que clasifica empleados, es probable que tengas un sistema de alto riesgo.

Servicios esenciales: crédito y seguros

También son de alto riesgo los sistemas que:

- Evalúan la solvencia o establecen el scoring crediticio de personas físicas

- Determinan precios o riesgo en seguros de vida y salud

Esto afecta directamente a entidades financieras, aseguradoras y cualquier empresa que use IA para decidir condiciones comerciales diferenciadas por cliente.

Otras categorías relevantes

- Biometría — reconocimiento facial para control de acceso, identificación de personas

- Educación — sistemas que evalúan estudiantes, deciden admisiones o califican exámenes automáticamente

- Infraestructura crítica — IA en gestión de redes energéticas, agua o transporte

- Administración de justicia y aplicación de la ley — aplica principalmente a administraciones públicas

La Comisión Europea ha publicado una herramienta de autodiagnóstico, el AI Act Compliance Checker, para que cualquier empresa evalúe si sus sistemas entran en el Anexo III. Es el primer paso obligatorio, y no lleva más de una hora por sistema.

La novedad de Q2 2026: los agentes de IA también están dentro

En abril de 2026, la Comisión Europea aclaró formalmente que los agentes de IA no constituyen una categoría legal separada. Las definiciones existentes del Reglamento — «sistema de IA» y «modelo de IA de propósito general» — son suficientes para cubrirlos.

La consecuencia práctica es clara: si tienes desplegado un agente basado en Copilot, OpenAI Agents, CrewAI o cualquier otro orquestador, y ese agente ejecuta funciones que caen en el Anexo III (por ejemplo, filtrar candidatos, evaluar solvencia o monitorizar empleados), se le aplican exactamente las mismas obligaciones que a cualquier otro sistema de alto riesgo.

Esta aclaración llega en un momento en que muchas empresas están desplegando agentes de IA con rapidez, a menudo sin haber realizado la evaluación de riesgo previa que el Reglamento exige.

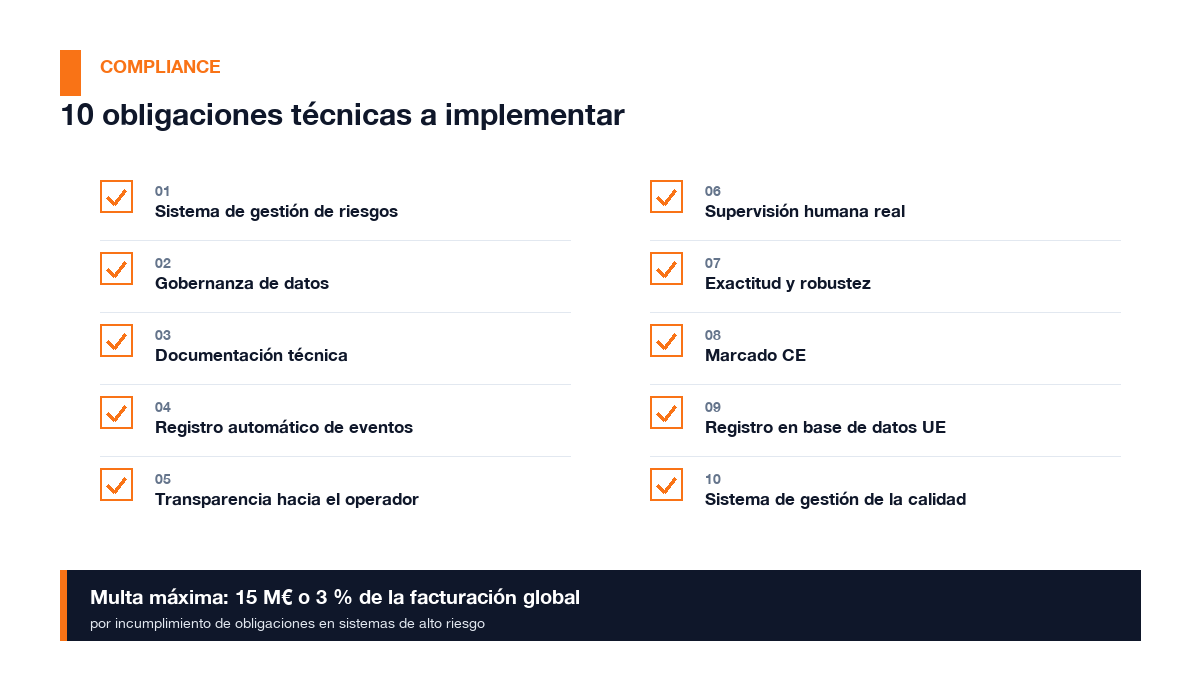

El checklist de 10 obligaciones para sistemas de alto riesgo

Cada uno de estos diez puntos requiere trabajo previo. Ninguno se implementa en una semana.

Cada uno de estos diez puntos requiere trabajo previo. Ninguno se implementa en una semana.

Si uno o varios de tus sistemas caen en el Anexo III, estas son las obligaciones que debes tener implementadas antes del 2 de agosto:

- Sistema de gestión de riesgos — proceso continuo y documentado, no un análisis puntual

- Gobernanza de datos — calidad, representatividad y origen de los datos de entrenamiento

- Documentación técnica — elaborada antes del despliegue: qué hace el sistema, qué datos usa, cómo fue evaluado

- Registro automático de eventos — logs que permitan reconstruir las decisiones del sistema

- Transparencia hacia el operador — instrucciones de uso, limitaciones conocidas, nivel de supervisión requerido

- Supervisión humana real — mecanismos efectivos de intervención, no meramente formales

- Exactitud y robustez — métricas de precisión documentadas y monitorizadas

- Marcado CE — obligatorio para sistemas que se comercializan en el mercado europeo

- Registro en la base de datos de la UE — requerido para la mayoría de sistemas del Anexo III

- Sistema de gestión de la calidad — proceso interno que garantice el cumplimiento continuo

AESIA: el regulador español ya está activo

España fue el primer país de la UE en crear una autoridad nacional dedicada a la supervisión de la IA.

España fue el primer país de la UE en crear una autoridad nacional dedicada a la supervisión de la IA.

España fue el primer Estado miembro de la UE en crear una autoridad nacional específica de supervisión de IA. La Agencia Española de Supervisión de la Inteligencia Artificial (AESIA), operativa desde junio de 2024, publicó en diciembre de ese año dieciséis checklists y guías prácticas no vinculantes para ayudar a las empresas a entender sus obligaciones.

A partir del 2 de agosto de 2026, AESIA tendrá poderes plenos de inspección, apertura de expedientes y sanción. Las multas contempladas en el Reglamento son:

- Hasta 35 millones de euros o el 7 % de la facturación global (la cantidad que sea mayor) para usos prohibidos

- Hasta 15 millones de euros o el 3 % de la facturación global para incumplimiento de obligaciones de sistemas de alto riesgo

- Hasta 7,5 millones o el 1,5 % para información incorrecta facilitada a las autoridades

Para una empresa con 50 millones de euros de facturación, el 3 % son 1,5 millones. No es un riesgo teórico.

Nuestra opinión: la ventana es ahora, no en julio

En Tecnea llevamos tiempo viendo cómo la adopción empresarial de la IA va mucho más despacio que la regulación. El AI Act es, en este sentido, un caso inverso: la normativa avanza más deprisa de lo que muchas empresas creen.

La buena noticia es que la mayoría de empresas medianas no tienen decenas de sistemas de alto riesgo. Con frecuencia, la evaluación inicial revela que uno o dos sistemas requieren atención, y que el resto queda fuera del Anexo III.

El error que estamos viendo repetirse es esperar a que alguien de fuera — un proveedor, un consultor de última hora, una noticia de prensa — active la urgencia. Para entonces, los plazos para hacer bien la documentación técnica y los procesos de gestión de riesgos se habrán comprimido demasiado.

El primer paso — la clasificación de sistemas — no requiere grandes recursos. Requiere tiempo y criterio. Quienes lo hagan ahora llegarán al 2 de agosto con margen. Quienes esperen a julio, probablemente no.

Preguntas frecuentes

¿El AI Act afecta a las PYMEs? Sí, aunque con matices. Las obligaciones se aplican a cualquier empresa que desarrolle o despliegue sistemas de IA en la UE, independientemente de su tamaño. Existen algunas simplificaciones procedimentales para microempresas, pero las obligaciones de fondo — clasificar, documentar y gestionar riesgos — son las mismas. El tamaño no exime; sí puede justificar procesos más ligeros si el sistema tiene menor impacto.

¿Usar ChatGPT o Copilot en mi empresa me convierte en proveedor de alto riesgo? No directamente. Cuando usas un modelo de IA de propósito general como herramienta interna (redactar documentos, resumir información, asistir tareas genéricas), normalmente eres un «usuario» bajo el Reglamento, con obligaciones más ligeras. El problema surge cuando integras ese modelo en un proceso de decisión que afecta a personas: contratación, crédito, evaluación de rendimiento. Ahí la clasificación cambia.

¿Qué es exactamente la obligación de «alfabetización en IA» del Artículo 4? Desde febrero de 2025, todas las organizaciones que usen o desarrollen sistemas de IA deben garantizar que su personal tiene un nivel suficiente de comprensión sobre cómo funcionan esos sistemas, sus capacidades, sus limitaciones y sus riesgos. No existe un formato obligatorio: puede ser formación interna, talleres o documentación. Pero debe quedar registrado.

¿Los sistemas comprados a proveedores tecnológicos son responsabilidad del proveedor o mía? La responsabilidad es compartida. El proveedor (fabricante o distribuidor del sistema) tiene obligaciones de cumplimiento propias. Pero como empresa que despliega el sistema, tienes obligaciones adicionales como operador: asegurarte de que el sistema se usa conforme a sus instrucciones, implementar supervisión humana y notificar incidentes graves. No es suficiente con que el proveedor diga que cumple el AI Act.

¿Qué ocurre si el 2 de agosto no tengo todo en orden? Depende de la situación concreta. La Comisión y AESIA tienen potestad de abrir investigaciones, requerir información, ordenar medidas correctoras y, en última instancia, imponer multas. En la práctica, las primeras acciones de supervisión se centrarán en los casos más graves o más visibles. Pero eso no significa que el riesgo sea teórico: tener la documentación y los procesos en marcha es la única posición defensible ante una inspección.

Fuentes

- Anexo III del AI Act — artificialintelligenceact.eu

- EU AI Act Compliance Calendar — Delbion

- EU AI Act 2026 Updates — Legalnodes

- AI Act: Guía cumplimiento empresas españolas — Javadex

- AESIA y el AI Act en España — EU AI Compass

- El AI Act y los agentes de IA, Q2 2026 — Economist Jurist

- AESIA guidelines — IAPP

¿Te ha resultado útil este artículo?

Publicamos análisis sobre IA y tecnología empresarial. Sin spam — solo cuando escribamos algo que valga la pena leer.

¿Listo para transformar tu negocio?

Hablemos de cómo podemos ayudarte a implementar estas soluciones en tu empresa.

Contáctanos