AI Act: faltam menos de 100 dias — o que devem fazer as empresas portuguesas

Jorge García

Tecnea

A 2 de agosto de 2026 faltam menos de cem dias. Essa data marca a aplicação plena das obrigações do AI Act europeu para a maioria dos sistemas de inteligência artificial implementados em empresas. Não é uma data simbólica: nesse dia a ANACOM — autoridade principal designada pelo Governo português para supervisionar o AI Act — terá poderes plenos de inspeção e sanção, e a Comissão Europeia ativará a sua capacidade de multar os fornecedores dos grandes modelos de IA.

A pergunta que os responsáveis de tecnologia e operações de qualquer empresa média portuguesa deveriam estar a fazer neste momento não é se o AI Act os afeta. A pergunta é: quantos sistemas de IA de alto risco têm implementados sem o saberem?

A resposta, em muitos casos, vai surpreender.

A linha de tempo completa: o que já obriga e o que chega em agosto

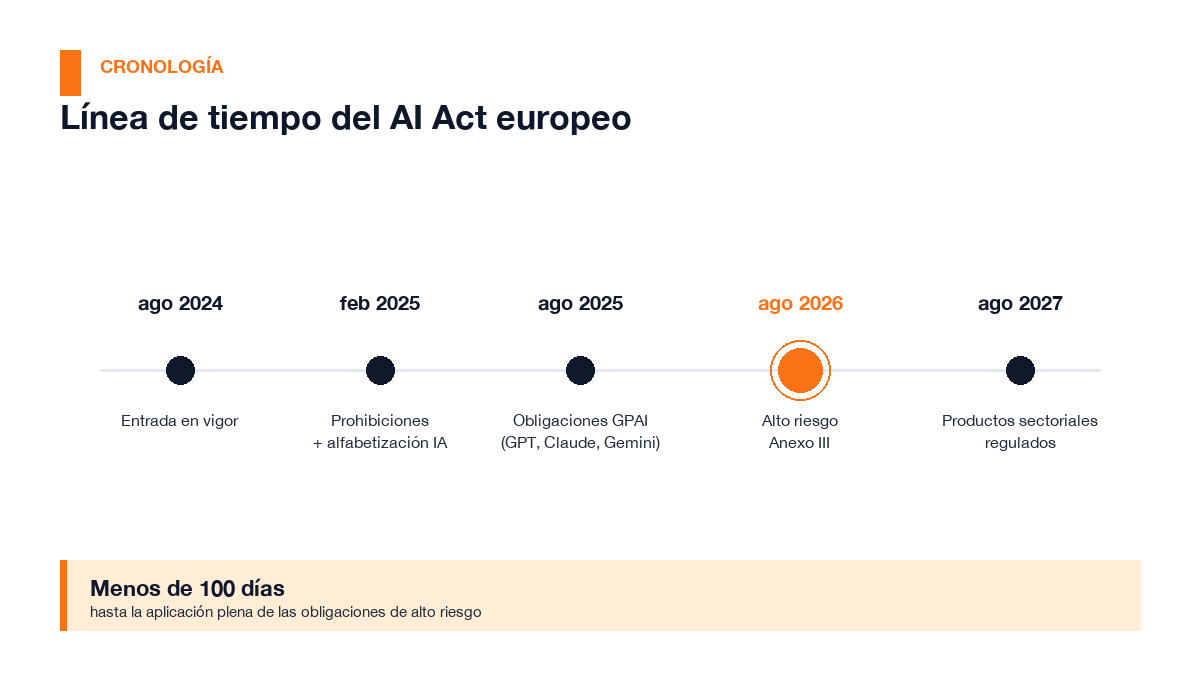

O AI Act tem entrado em vigor por camadas desde agosto de 2024. A data crítica para a maioria das empresas é 2 de agosto de 2026.

O AI Act tem entrado em vigor por camadas desde agosto de 2024. A data crítica para a maioria das empresas é 2 de agosto de 2026.

O AI Act não chegou de uma só vez. Leva dois anos a entrar em vigor por camadas, e a maioria das obrigações críticas concentra-se precisamente agora:

- Agosto 2024 — O Regulamento entra oficialmente em vigor.

- Fevereiro 2025 — Proibições absolutas (Art. 5): manipulação subliminar, exploração de vulnerabilidades, scoring social em massa. Obrigação de literacia em IA (Art. 4) para todo o pessoal que trabalhe com sistemas de IA.

- Agosto 2025 — Obrigações para modelos de IA de uso geral (GPAI): GPT, Claude, Gemini, Llama. Normas de governança e documentação técnica.

- 2 agosto 2026 — Obrigações plenas para sistemas de alto risco (Anexo III). Poderes de sanção da Comissão sobre GPAI. Regras de transparência.

- Agosto 2027 — Sistemas de alto risco integrados em produtos setoriais já regulados (maquinaria, dispositivos médicos…).

Há um pormenor que poucos artigos referem: alguns sistemas autónomos do Anexo III têm, na verdade, até dezembro de 2027. Mas isso não é desculpa para esperar: a classificação de sistemas é obrigatória para todos desde já, e os processos de documentação técnica e gestão de riscos levam meses de trabalho.

Tem sistemas de alto risco sem o saber?

As 8 categorias do Anexo III. As mais frequentes em empresas médias portuguesas são Emprego/RH e Serviços essenciais (crédito, seguros).

As 8 categorias do Anexo III. As mais frequentes em empresas médias portuguesas são Emprego/RH e Serviços essenciais (crédito, seguros).

O Anexo III do AI Act define oito categorias de sistemas considerados de alto risco. Não é preciso ter tecnologia de ponta para cair numa delas. Estas são as mais frequentes em empresas médias portuguesas:

Emprego e recursos humanos

É provavelmente a categoria que mais empresas ignoram. São de alto risco os sistemas de IA que:

- Filtram ou pontuam candidaturas de emprego de forma automatizada

- Avaliam candidatos durante processos de seleção

- Tomam ou assistem decisões de promoção, reafetação ou despedimento

- Monitorizam e avaliam o desempenho de colaboradores

Se a sua empresa usa um ATS (sistema de seguimento de candidatos) com pontuação automática, ou uma ferramenta de People Analytics que classifica colaboradores, é provável que tenha um sistema de alto risco.

Serviços essenciais: crédito e seguros

Também são de alto risco os sistemas que:

- Avaliam a solvência ou estabelecem o scoring creditício de pessoas singulares

- Determinam preços ou risco em seguros de vida e saúde

Isto afeta diretamente instituições financeiras, seguradoras e qualquer empresa que use IA para decidir condições comerciais diferenciadas por cliente.

Outras categorias relevantes

- Biometria — reconhecimento facial para controlo de acesso, identificação de pessoas

- Educação — sistemas que avaliam estudantes, decidem admissões ou classificam exames automaticamente

- Infraestrutura crítica — IA na gestão de redes energéticas, água ou transporte

- Administração da justiça e aplicação da lei — aplica-se principalmente a administrações públicas

A Comissão Europeia publicou uma ferramenta de autodiagnóstico, o AI Act Compliance Checker, para que qualquer empresa avalie se os seus sistemas caem no Anexo III. É o primeiro passo obrigatório e não demora mais de uma hora por sistema.

A novidade do Q2 2026: os agentes de IA também estão incluídos

Em abril de 2026, a Comissão Europeia clarificou formalmente que os agentes de IA não constituem uma categoria legal separada. As definições existentes do Regulamento — «sistema de IA» e «modelo de IA de uso geral» — são suficientes para os abranger.

A consequência prática é clara: se tem um agente implementado baseado em Copilot, OpenAI Agents, CrewAI ou qualquer outro orquestrador, e esse agente executa funções que caem no Anexo III (por exemplo, filtrar candidatos, avaliar solvência ou monitorizar colaboradores), aplicam-se exatamente as mesmas obrigações que a qualquer outro sistema de alto risco.

Esta clarificação chega num momento em que muitas empresas estão a implementar agentes de IA rapidamente, frequentemente sem terem feito a avaliação de risco prévia que o Regulamento exige.

A checklist das 10 obrigações para sistemas de alto risco

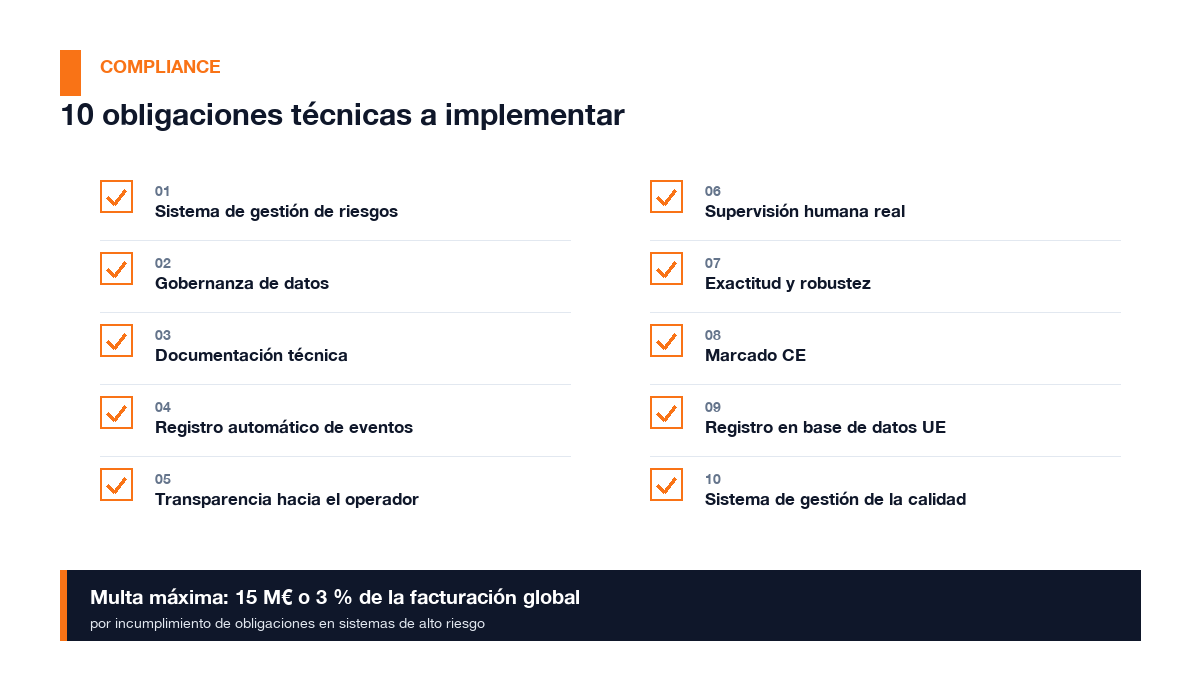

Cada um destes dez pontos requer trabalho prévio. Nenhum se implementa numa semana.

Cada um destes dez pontos requer trabalho prévio. Nenhum se implementa numa semana.

Se um ou vários dos seus sistemas caem no Anexo III, estas são as obrigações que deve ter implementadas antes de 2 de agosto:

- Sistema de gestão de riscos — processo contínuo e documentado, não uma análise pontual

- Governança de dados — qualidade, representatividade e origem dos dados de treino

- Documentação técnica — elaborada antes da implementação: o que faz o sistema, que dados usa, como foi avaliado

- Registo automático de eventos — logs que permitam reconstruir as decisões do sistema

- Transparência perante o operador — instruções de uso, limitações conhecidas, nível de supervisão exigido

- Supervisão humana real — mecanismos efetivos de intervenção, não meramente formais

- Exatidão e robustez — métricas de precisão documentadas e monitorizadas

- Marcação CE — obrigatória para sistemas colocados no mercado europeu

- Registo na base de dados da UE — exigido para a maioria dos sistemas do Anexo III

- Sistema de gestão da qualidade — processo interno que garanta o cumprimento contínuo

ANACOM: o regulador português já está ativo

Portugal designou a ANACOM como autoridade principal em setembro de 2025, coordenando 14 reguladores setoriais.

Portugal designou a ANACOM como autoridade principal em setembro de 2025, coordenando 14 reguladores setoriais.

Em setembro de 2025, o Governo português designou a ANACOM — Autoridade Nacional de Comunicações — como autoridade principal de supervisão do AI Act. A ANACOM coordena uma rede de catorze autoridades setoriais competentes, entre as quais a Inspeção-Geral das Finanças, a Autoridade para as Condições do Trabalho, a Entidade Reguladora da Saúde, a Polícia Judiciária ou a Entidade Reguladora dos Serviços Energéticos. A Comissão Nacional de Proteção de Dados (CNPD) mantém, em paralelo, competências próprias em tudo o que toca a dados pessoais e biometria.

A Agenda Nacional para a Inteligência Artificial foi aprovada a 8 de janeiro de 2026, consolidando a política portuguesa de adoção e supervisão da IA.

A partir de 2 de agosto de 2026, estas autoridades terão poderes plenos de inspeção, abertura de processos e sanção. As multas previstas no Regulamento são:

- Até 35 milhões de euros ou 7 % da faturação global (o valor mais elevado) para usos proibidos

- Até 15 milhões de euros ou 3 % da faturação global por incumprimento de obrigações de sistemas de alto risco

- Até 7,5 milhões ou 1,5 % por informação incorreta fornecida às autoridades

Para uma empresa com 50 milhões de euros de faturação, 3 % são 1,5 milhões. Não é um risco teórico.

A nossa opinião: a janela é agora, não em julho

Na Tecnea há muito que observamos como a adoção empresarial da IA vai muito mais devagar do que a regulação. O AI Act é, neste sentido, um caso inverso: a normativa avança mais depressa do que muitas empresas julgam.

A boa notícia é que a maioria das empresas médias não tem dezenas de sistemas de alto risco. Frequentemente, a avaliação inicial revela que um ou dois sistemas precisam de atenção e que o resto fica fora do Anexo III.

O erro que vemos repetir-se é esperar que alguém de fora — um fornecedor, um consultor de última hora, uma notícia de imprensa — ative a urgência. Nessa altura, os prazos para preparar bem a documentação técnica e os processos de gestão de riscos terão ficado comprimidos em excesso.

O primeiro passo — a classificação de sistemas — não requer grandes recursos. Requer tempo e critério. Quem o fizer agora chegará a 2 de agosto com margem. Quem esperar até julho, provavelmente não.

Perguntas frequentes

O AI Act afeta as PME? Sim, embora com matizes. As obrigações aplicam-se a qualquer empresa que desenvolva ou implemente sistemas de IA na UE, independentemente do seu tamanho. Existem algumas simplificações procedimentais para microempresas, mas as obrigações de fundo — classificar, documentar e gerir riscos — são as mesmas. O tamanho não isenta; pode justificar processos mais leves se o sistema tiver menor impacto.

Usar o ChatGPT ou o Copilot na minha empresa torna-me fornecedor de alto risco? Não diretamente. Quando usa um modelo de IA de uso geral como ferramenta interna (redigir documentos, resumir informação, assistir tarefas genéricas), é normalmente um «utilizador» ao abrigo do Regulamento, com obrigações mais leves. O problema surge quando integra esse modelo num processo de decisão que afeta pessoas: contratação, crédito, avaliação de desempenho. Aí a classificação muda.

Em que consiste exatamente a obrigação de «literacia em IA» do Artigo 4? Desde fevereiro de 2025, todas as organizações que usem ou desenvolvam sistemas de IA devem garantir que o seu pessoal tem um nível suficiente de compreensão sobre como esses sistemas funcionam, as suas capacidades, limitações e riscos. Não existe um formato obrigatório: pode ser formação interna, workshops ou documentação. Mas tem de ficar registado.

Os sistemas comprados a fornecedores tecnológicos são responsabilidade do fornecedor ou minha? A responsabilidade é partilhada. O fornecedor (fabricante ou distribuidor do sistema) tem obrigações de cumprimento próprias. Mas como empresa que implementa o sistema, tem obrigações adicionais enquanto operador: garantir que o sistema é usado conforme as instruções, implementar supervisão humana e notificar incidentes graves. Não basta o fornecedor dizer que cumpre o AI Act.

O que acontece se a 2 de agosto não tiver tudo em ordem? Depende da situação concreta. A Comissão Europeia e as autoridades nacionais (em Portugal, a ANACOM e as autoridades setoriais coordenadas) têm poderes para abrir investigações, exigir informação, ordenar medidas corretivas e, em última instância, aplicar multas. Na prática, as primeiras ações de supervisão vão concentrar-se nos casos mais graves ou mais visíveis. Mas isso não significa que o risco seja teórico: ter a documentação e os processos em marcha é a única posição defensável perante uma inspeção.

Fontes

- Anexo III do AI Act — artificialintelligenceact.eu

- ANACOM escolhida pelo governo para regular inteligência artificial em Portugal — AICEP

- AI Act Portugal — Portal de Conformidade com o Regulamento UE 2024/1689

- "AI Act": ANACOM assume supervisão em Portugal — Andersen

- AI Act — Shaping Europe's digital future, European Commission

- EU AI Act Compliance Calendar — Delbion

¿Te ha resultado útil este artículo?

Publicamos análisis sobre IA y tecnología empresarial. Sin spam — solo cuando escribamos algo que valga la pena leer.

Pronto para transformar o seu negócio?

Vamos falar sobre como podemos ajudá-lo a implementar estas soluções na sua empresa.

Contacte-nos